AGI (Artificial General Intelligence або укр. загальний штучний інтелект) — це клас систем штучного інтелекту, які мають виконувати широкий спектр інтелектуальних завдань на рівні, близькому до людського, і переносити набуті знання та навички між різними сферами без окремого перенавчання під кожну з них. У фаховій і популярній мові цей термін також вживають як синонім до понять «сильний штучний інтелект» і «штучний генералізований інтелект», але станом на сьогодні йдеться переважно про дослідницьку мету та теоретичну модель, а не про загальновизнаний готовий продукт.

Що таке AGI — визначення і суть простими словами

Простими словами, AGI — це не просто програма, яка добре робить одну конкретну справу, а система, що вміє вчитися новому, підлаштовуватися під незнайомі завдання і переносити досвід із однієї сфери в іншу.

Якщо звести концепцію AGI до базового рівня пояснення, то йдеться про модель на кшталт «один мозок — багато професій»: сьогодні вона аналізує текст, завтра розбирається в новому інтерфейсі, післязавтра планує дії в незнайомому середовищі, і щоразу не стартує з нуля. У цьому й суть AGI простими словами: не набір окремих трюків, а загальна здатність розуміти задачу, вчитися по ходу і застосовувати вже набуте там, де раніше досвіду не було.

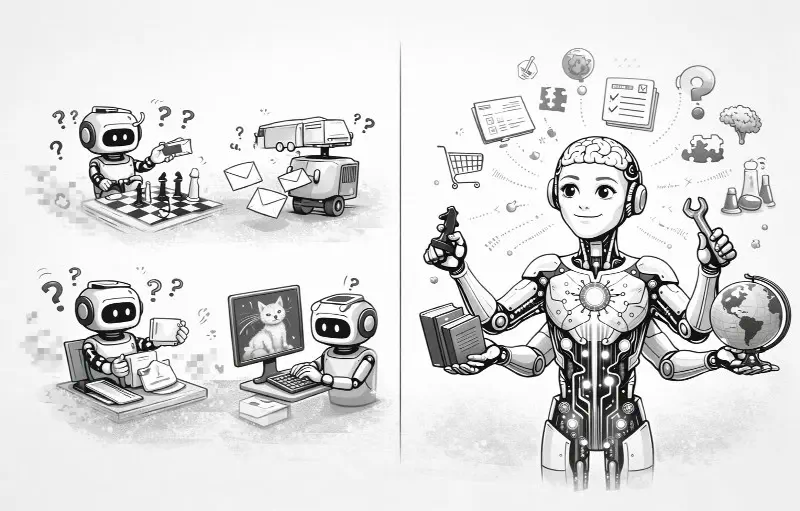

Для контрасту, вузький штучний інтелект працює інакше: він може бути майже бездоганним у своїй ніші — наприклад, у перекладі, грі в шахи чи розпізнаванні зображень, — але легко «сиплеться», коли виходить за межі сценарію, під який його створили. Саме тому чат-бот, генератор картинок або навіть сильна мовна модель ще не дорівнює AGI лише тому, що виглядає універсальною.

Є і дрібна, але корисна ремарка стосовно акроніму яка іноді викликає плутанину: AGI — абревіатура не лише зі сфери штучного інтелекту; наприклад, у податковому контексті США AGI часто означає Adjusted Gross Income, тобто скоригований валовий дохід.

Навіщо окремий термін AGI, якщо вже є «штучний інтелект»

Проблема в тому, що словосполучення «штучний інтелект» у живій мові давно стало парасолькою на пів інтернету. Під ним однаково можуть мати на увазі фільтр спаму в пошті, рекомендації в YouTube, автопереклад, генератор зображень, голосового помічника, робота на складі або модель, яка пише код. Тобто слово одне, а класів систем усередині нього — цілий ярмарок. Саме тому окремий термін потрібен не для “моднішого звучання”, а щоб відрізнити будь-який ШІ від систем, яким приписують широку загальність, тобто здатність працювати не в одній вузькій ніші, а в дуже різних інтелектуальних задачах. І міжнародні документи про термінологію ШІ теж йдуть саме від цього: спершу треба розвести поняття, інакше далі починається каша.

Інакше кажучи, слово AI / ШІ відповідає на запитання «до якої великої родини належить система?», а AGI — на запитання «наскільки вона загальна за своїми здібностями?» Це вже не про сам факт використання алгоритмів чи нейромереж, а про масштаб охоплення задач. Якщо модель чудово розпізнає мовлення, але не вміє самостійно розібратися з новою логічною грою, не переносить навички між доменами і ламається за межами натренованого сценарію, це ще не те, що зазвичай мають на увазі під AGI. Окремий термін тут працює як технічний маркер: він звужує поле й відсікає все, що просто “розумне”, але не є достатньо універсальним.

Чому не можна просто сказати «сильний ШІ» — і закрити тему

Можна. Але лише частково. У медіа й побутовій мові AGI, загальний ШІ і сильний штучний інтелект часто використовують майже як синоніми. Для широкого загалу це зрозуміло: всі три варіанти натякають на систему людського рівня або близьку до нього за широтою здібностей. Проте в академічних і філософських контекстах слово strong AI інколи тягне за собою ще одну стару суперечку — чи означає така система не лише успішну поведінку, а й справжнє розуміння, свідомість або ментальні стани. Саме на цьому ґрунті, наприклад, будувалася відома критика Джона Серла з його аргументом про «китайську кімнату». Тому для термінологічної статті AGI зручніший: він точніше прив’язаний до теми загальності інтелекту, а не затягує читача одразу в філософію свідомості.

Тобто окремий термін потрібен ще й для гігієни розмови. Він дозволяє сказати: зараз ми говоримо не про те, чи “відчуває” машина щось, не про те, чи вона має суб’єктивний досвід, і не про те, наскільки переконливо вона імітує людину в діалозі. Ми говоримо про іншу річ: чи може система загально розв’язувати широкий клас інтелектуальних завдань, навчатися новому і діяти за межами вузької спеціалізації. Це значно тверезіша постановка питання.

Нове слово чи нова сутність

Тепер до головного. AGI — це не просто нова етикетка на старій коробці. Але й не повністю нова сутність у тому сенсі, ніби існує якийсь окремий “вид розуму”, не пов’язаний із ширшим полем штучного інтелекту. Правильніше сказати так: AGI — це підклас або цільовий режим ШІ, у якому на перший план виходить не спеціалізація, а ширина та гнучкість інтелекту. Тобто слово нове не задля прикраси. Воно потрібне, бо предмет розмови інший. Коли ми кажемо “штучний інтелект”, ми можемо мати на увазі тисячу різних речей. Коли кажемо “AGI”, ми звужуємо тему до конкретної амбіції: зробити систему, яка не застрягає в одному домені й не потребує окремої збірки мозку під кожну нову роботу.

Звідси й постійна плутанина в новинах. Щойно якась модель показує сильні результати в багатьох бенчмарках або отримує агентні функції, починаються розмови в стилі “ну все, це вже майже AGI”. Але “майже універсальний інструмент” і “загальний інтелект” — не те саме. Багатофункціональність сама по собі ще не доводить ані глибокого перенесення навичок, ані стійкого узагальнення, ані автономності потрібного рівня. Через це термін AGI одночасно корисний і незручний: корисний, бо відсікає шум, а незручний, бо змушує одразу уточнювати критерії.

Єдиного стандартного визначення немає. І це не дрібниця

Ось тут починається найчесніша частина розмови. Єдиного загальноприйнятого стандартного визначення AGI немає. Не тому, що ніхто не може скласти одне речення, а тому, що різні дослідницькі групи, компанії й філософські школи міряють “загальність” по-різному. Для одних у центрі — економічна корисність і автономність. Для інших — здатність до узагальнення в широкому наборі середовищ. Для третіх — швидкість опанування нових навичок із мінімумом прикладів. Тому той самий термін може виглядати схожим, а насправді спиратися на різні критерії фінішу.

Наприклад, у статутних документах OpenAI AGI описують як високоавтономні системи, що перевершують людей у більшості економічно цінної роботи. Це робоче, практичне визначення, заточене під місію та управління технологією. Але воно не є нейтральним універсальним стандартом для всієї науки. У дослідницьких рамках на кшталт Levels of AGI акцент зміщують у бік осей performance–generality–autonomy, тобто продуктивності, широти застосування й автономності. А в більш формальних підходах, пов’язаних із роботами Шейна Легга і Маркуса Гуттера, інтелект описують через здатність досягати цілей у широкому класі середовищ. Бачите? Предмет ніби один, а погляди різні.

Через це не можна сказати ніби всі давно домовилися, що саме вважати AGI, а що ні. Не домовилися. І це нормально. У молодих або швидко рухомих технологічних полях таке трапляється постійно: термін уже дуже популярний, а межі ще рухливі. Для нас це означає просту річ: коли хтось заявляє “ми досягли AGI” або “до AGI залишилось п’ять років”, завжди треба питати — за яким саме визначенням? Без цього будь-яка гучна фраза зависає в повітрі.

Чим AGI відрізняється від ANI, ASI та генеративного ШІ

Коли люди запитують чим особливим відрізняється AGI від інших ШІ, вони зазвичай змішують в одну купу чотири різні речі: рівень здібностей системи, широту її застосування, ступінь автономності й тип самої моделі. Через це запити на кшталт AI і AGI, AGI і ANI або AGI і ASI часто дають плутанину замість відповіді. Насправді логіка проста: ANI, AGI та ASI — це умовні рівні або класи інтелектуальності, а генеративний ШІ — не окремий рівень, а тип систем, що створюють новий контент на основі навчання на даних.

- ANI (Artificial Narrow Intelligence) — це вузький ШІ, тобто система, заточена під конкретний клас задач. Вона може бути дуже сильною у своїй ніші, інколи навіть кращою за людину, але її сила локальна. Шаховий рушій не стає юристом, система розпізнавання облич не перетворюється на наукового консультанта, а алгоритм рекомендацій не починає сам розуміти фізику чи біологію. Механіка тут така: модель вчиться на певному типі даних і формує компетентність у межах визначеного простору рішень. Крок убік — і якість різко падає.

- AGI (Artificial General Intelligence) — це вже інша планка. Йдеться про систему, яка не просто накопичила багато окремих навичок, а вміє переносити знання між різними сферами, вчитися новому без повного перенавчання під кожне завдання і діяти в ширшому діапазоні ситуацій. Тобто не “один інструмент — одна функція”, а радше універсальний інтелектуальний механізм. Саме тому AGI часто описують як загальний ШІ: не через магію, а через широту задач, з якими він теоретично має справлятися.

- ASI (Artificial Superintelligence) — це вже наступний, гіпотетичний рівень. Якщо AGI зазвичай порівнюють із людською загальною здатністю мислити, то надінтелект, або суперінтелект, означає систему, що суттєво перевершує людину в більшості або майже в усіх когнітивних сферах: від аналізу й планування до наукового відкриття та стратегічного прогнозування. Це поки що концепт, а не підтверджена технічна реальність. Тому ставити ASI поруч із реальними продуктами сьогодні — трохи забігати наперед.

Окрема історія — генеративний ШІ та LLM (Large Language Models, великі мовні моделі). Вони вміють генерувати текст, код, зображення, звук або інші дані, тому зовні можуть здаватися майже універсальними. Але це ще не автоматичний квиток в AGI. Такі системи справді широкі за набором задач, проте часто залишаються крихкими: залежать від якості підказки, контексту, навчальних даних, зовнішніх інструментів і не завжди стабільно переносять навички в нові середовища. Тобто вони можуть бути частиною майбутньої архітектури AGI, але самі по собі не дорівнюють йому.

| Система | Сфера задач | Здатність вчитись новому | Автономність | Типові приклади |

| ANI | Вузька, одна або кілька близьких задач | Обмежена межами домену; перенос слабкий | Зазвичай низька або керована | Шахові програми, розпізнавання облич, рекомендаційні системи |

| AGI | Широка сфера | Має переносити знання між різними сферами | Середня або висока, залежно від архітектури | Поки що радше теоретична ціль, ніж визнаний готовий клас систем |

| ASI | Ширша за людську в більшості сфер | Теоретично надлюдська | Потенційно дуже висока | Гіпотетичний суперінтелект |

| Генеративний ШІ / LLM | Широкий набір задач у межах генерації та аналізу даних | Частково гнучка, але нестійка поза контекстом і без інструментів | Від низької до помірної в агентних конфігураціях | Чат-боти, генератори коду, зображень, мультимодальні асистенти |

Які ознаки має AGI: універсальність, узагальнення, автономність

Коли про систему кажуть, що вона наближається до AGI, зазвичай мають на увазі не один параметр, а поєднання кількох ознак. У сучасних рамках оцінювання найчастіше дивляться на три осі: продуктивність — наскільки добре система справляється із завданнями, ширина застосування — у скількох різних класах задач вона не губиться, і автономність — скільки кроків може зробити без постійного ведення за руку. Тобто мало просто відповідати правильно; треба ще вміти робити це в різних контекстах і не розсипатися на кожному новому повороті.

Як це виглядає?

- Продуктивність — система не лише “щось знає”, а стабільно розв’язує задачі на сильному рівні.

- Універсальність — вона переносить підхід між сферами, а не живе в одній вузькій ніші.

- Автономність — може сама розбити велику ціль на кроки, вибрати інструмент, перевірити результат і скоригувати план.

Звідси й набір ознак, які найчастіше записують у неформальний чекліст AGI. Перша — узагальнення: система не просто відтворює знайомий шаблон, а застосовує правило в новій ситуації. Друга — перенесення знань: навичка, здобута в одному завданні, допомагає в іншому, навіть якщо поверхнево вони не схожі. Третя — планування, коли модель не реагує імпульсивно на кожен запит, а тримає ціль, підцілі й послідовність дій. Четверта — робота з незнайомими умовами, без повного перенавчання з нуля. П’ята — навчання з малого числа прикладів, бо загальний інтелект цінний не тим, що бачив усе, а тим, що швидко вчиться на небагатому досвіді. Саме тому в теоріях інтелекту дедалі частіше підкреслюють не обсяг завченого, а ефективність набуття нових навичок.

Є ще одна практична риса — стійкість до зламу контексту. Це момент, коли система виглядає переконливо, доки все йде знайомою колією, але починає помилятися, щойно змінюються правила, формат даних або приховані умови задачі. Для AGI цього замало. Від нього очікують не просто широкого набору функцій, а поведінки, яка не валиться від кожного нестандартного повороту подій. Інакше це радше дуже вправний інструмент, ніж справді автономний агент.

Окреме питання — втіленість (embodiment). Частина дослідників вважає, що без тіла, сенсорики й взаємодії з реальним середовищем загальний інтелект буде неповним, бо значна частина пізнання виростає з дії, помилки, простору й причинно-наслідкових наслідків. Інша позиція обережніша: для багатьох критеріїв AGI може вистачити й софтверного агента, якщо він здатний узагальнювати, планувати і вчитися в достатньо багатому цифровому середовищі. Поки що це не закрите питання, а радше розвилка між двома дослідницькими ставками.

Отже, ознаки AGI і критерії AGI зводяться не до однієї гучної здібності, а до зв’язки властивостей: сильна продуктивність, широка придатність до різних задач, перенесення знань, планування, навчання на малому досвіді та достатня автономність. Якщо бодай одна з цих опор просідає, перед нами може бути дуже сильна система — але ще не загальний штучний інтелект.

Як перевіряють AGI: тести, бенчмарки і чому це важко

Коли люди питають як реально перевірити AGI, вони часто уявляють один великий іспит, після якого хтось урочисто ставить печатку: так, це вже загальний інтелект. Насправді так не працює. У сфері AGI немає одного всесвітньо визнаного екзаменатора і немає єдиного тесту, який закриває все питання. Сучасні рамки оцінювання радше говорять про поєднання трьох речей: як добре система виконує завдання, наскільки широкий клас задач вона охоплює і скільки дій може робити самостійно без постійного людського керування. Саме тому розмови про AGI дедалі менше крутяться навколо одного “супер-пупер тесту” і дедалі більше — навколо набору перевірок на узагальнення, перенесення навичок і практичну автономність.

Історично першим великим маркером був тест Тюрінга. У статті Computing Machinery and Intelligence Алан Тюрінг запропонував замінити розмите питання “чи може машина мислити?” на гру-імітацію, де співрозмовник має не відрізнити машину від людини в текстовому діалозі. Це був дуже сильний крок для свого часу: він перевів філософську суперечку в більш операційну форму. Але для AGI цього замало. Чому? Бо переконливо підтримати розмову — ще не те саме, що стабільно вчитися новому, будувати плани, працювати з незнайомими правилами і не “впадати в маразм” від зміни середовища. Машина може добре грати роль людини в діалозі й водночас провалювати завдання, де треба самостійно вивести нове правило.

Сучасний підхід жорсткіший. Дослідників цікавить не одне мега-питання, а пакет перевірок: бенчмарк на міркування, окремо перевірка на нові задачі без готового шаблону, окремо — на роботу з інструментами, планування, стійкість до зламу контексту, few-shot-навчання, тобто здатність схопити правило з кількох прикладів. Інакше кажучи, система має не просто “вражати”, а показувати, що вона справді переносить знання між задачами, а не красиво відтворює бачені патерни. Саме на цьому стоїть і сучасна рамка рівнів AGI, і підходи на кшталт роботи Франсуа Шолле, де інтелект пов’язують не лише з уже набутим умінням, а зі швидкістю набуття нових навичок.

Одним із найвідоміших прикладів тут став ARC-AGI. Його ідея не в тому, щоб перевірити енциклопедичну пам’ять чи натренованість на мільйоні знайомих задач, а в тому, щоб дати системі нову головоломку і подивитися, чи вона зрозуміє приховане правило майже “з ходу”. Це близько до людської ситуації, коли вам показують кілька прикладів перетворення, а далі просять застосувати принцип до нового випадку. Наприклад, система має побачити, що кольорові блоки на сітці треба не просто копіювати, а, скажімо, дзеркально відобразити, відфільтрувати зайвий елемент або завершити фігуру за новим правилом, якого ніхто окремо не пояснював. Такі задачі болючі для моделей саме тому, що тут не вистачає “нахапаного з прикладів досвіду”; треба справді вивести правило.

Але й тут є холодний душ. Високий результат на ARC-AGI не дорівнює автоматично висновку “ну ось він, загальний розум”. Це дуже цінний бенчмарк, але все ще бенчмарк — одна сім’я завдань із певною конструкцією. Система може навчитися добре працювати саме з таким форматом і все одно залишатися крихкою поза ним. Тому сильний бал на ARC-AGI радше означає, що модель просунулась у напрямку абстрактного міркування й швидкого набуття навичок, а не те, що питання AGI закрите раз і назавжди. Недарма навколо ARC виросла ціла екосистема відкритих змагань, зокрема через ARC Prize та пов’язані з ним конкурси, де прогрес видно, але так само видно й межі цього прогресу.

Ось чому в цій темі постійно повторюють неприємну, але здорову формулу: демо не дорівнює надійність. Модель може блискуче пройти сценічну демонстрацію, написати код, розв’язати нетривіальну задачу чи пояснити нову гру — а потім спіткнутися на дрібниці, якщо трохи змінити умови, формат або прихований контекст. Це одна з причин, чому навіть гучні роботи на кшталт Sparks of Artificial General Intelligence викликали не лише захват, а й скепсис: показові успіхи справді були вражаючими, але самі автори говорили про ранній, неповний етап, а не про остаточно доведений AGI. У перекладі на нормальну мову: один красивий виступ ще не робить систему стабільно загальною.

Тому відповідь на запитання “хто вирішує, що це вже AGI?” звучить прозаїчно. Ніхто одноосібно. Це поступово вирішує спільнота через сукупність перевірок, відтворюваних результатів і того, наскільки система показує узагальнення не в одному ролику чи пресрелізі, а в різних незалежних умовах. Саме тому розмова про AGI така болюча: межа тут не намальована фломастером. Її доводиться виборювати на стику тестів, бенчмарків, практичної автономності й дуже неприємних запитань до надійності.

Як створюють AGI: основні підходи (нейромережі, символіка, гібриди, емуляція мозку)

Коли ставлять питання, як взагалі можна побудувати повноцінний AGI, відповіді зазвичай зводяться до чотирьох великих напрямів. Жоден із них поки не став фінальним рецептом. У кожного своя сильна сторона, своя сліпа зона і своя ціна помилки.

Нейромережевий підхід: сила масштабу, але не гарантія розуміння

Найпомітніший сьогодні шлях — великі нейромережі та фундаментальні моделі. Їхня логіка така: система вчиться на дуже великому обсязі даних, знаходить статистичні закономірності, а потім починає переносити ці закономірності на нові задачі. Саме тому сучасні мультимодальні моделі можуть працювати з текстом, зображенням, кодом, аудіо й частково з діями. Це вже не вузький інструмент в одній ніші, а щось ближче до універсального цифрового ядра.

Сила цього підходу — у масштабі, гнучкості та здатності вчитися не по жорстко виписаних правилах, а з прикладів. Слабкість — у тому, що така система не завжди розуміє причинно-наслідкові зв’язки так, як це робить людина. Вона може блискуче узагальнювати в знайомому класі ситуацій, але ламатися на задачі, де треба стабільне міркування, довге планування або надійна робота в новому середовищі. Саме тому масштабування саме по собі ще не дорівнює AGI: широка поведінка не завжди означає глибоку загальність.

Символьний підхід: правила, логіка, прозорість

Інший класичний варіант — символьний або логічний підхід. Тут система працює не як велика статистична модель, а як механізм, що оперує формальними правилами, поняттями, структурами знань і логічними висновками. Його плюс очевидний: якщо правило задане, можна простежити, чому система дійшла саме такого висновку. Це ближче до прозорості, перевірності й контрольованого міркування.

Але є й проблема. Реальний світ хаотичний, неповний і не любить акуратних таблиць. Формально описати всі винятки, контексти, двозначності й побутові дрібниці майже нереально. Через це символьні системи добре почуваються там, де правила відносно чіткі, але гірше масштабуються до хаотичного живого середовища. Тобто логіка в них сильна, а гнучкість — не завжди.

Гібридний ШІ: спроба зібрати сильні сторони в одну архітектуру

Саме тому багатьом дослідникам ближчий гібридний ШІ. Ідея проста: поєднати нейромережеву здатність вчитися з даних із символьними механізмами пам’яті, правил, планування й перевірки. У такій схемі нейромережа може відповідати за сприйняття, узагальнення й роботу з шумними даними, а символьний шар — за логіку, структуровані знання, довгі ланцюги рішень і пояснюваність.

Тут часто згадують і когнітивні архітектури — спроби змоделювати не одну окрему навичку, а цілий набір механізмів мислення: пам’ять, увагу, вибір дій, навчання, планування, виправлення помилок. Проблема в тому, що зшити це все в одну живу систему дуже складно. На папері виглядає красиво. У реальному інженерному виконанні — купа вузлів, які мають не конфліктувати між собою.

Емуляція мозку: найрадикальніший шлях

Є ще один напрям, який часто приваблює саме своєю радикальністю, — емуляція мозку. Сенс не в тому, щоб вигадати інтелект із нуля, а в тому, щоб максимально точно відтворити механізми, на яких працює людський мозок. У межах обчислювальної нейробіології це може означати моделювання нейронних мереж мозку, динаміки сигналів, локальних схем навчання, а в найсильнішій версії — whole brain emulation, тобто спробу відтворити мозок як систему.

Цей підхід звучить спокусливо: якщо природний інтелект уже існує, може, варто не винаходити новий, а розібрати й зібрати його принципи. Але тут одразу впираємося в кілька дуже товстих стін. По-перше, нам бракує повної карти того, які саме механізми в мозку є критичними для загального інтелекту. По-друге, сам масштаб біологічної системи колосальний. По-третє, залишається питання втіленості: чи можна отримати людську гнучкість мислення без тіла, сенсорики, моторики й взаємодії зі світом, чи мозок без середовища — це вже інша система. Тут чесна відповідь одна: шлях можливий у теорії, але практично він дуже далекий і дуже дорогий у знанні.

Проміжний етап: узагальнені агенти, роботи й віртуальні світи

Між вузьким ШІ й гіпотетичним AGI зараз особливо цікаві узагальнені агенти. Це системи, які вчаться діяти одразу в кількох типах середовищ: у тексті, в іграх, у візуальних задачах, у робототехніці або у віртуальних світах. Такі агенти корисні тим, що дозволяють перевіряти не лише відповіді, а й поведінку: чи може система поставити ціль, вибрати інструмент, виправити хибний крок, адаптуватися до нового правила.

Віртуальні середовища тут працюють як тренажер. Роботика — як жорсткіша перевірка реальністю, де помилки не сховаєш красивим текстом. Але й тут не варто поспішати з гучними ярликами: навіть дуже широкий агент може бути крихким, якщо його компетентність тримається на специфічному наборі даних, підказок або сценаріїв.

Отже, підходи до AGI сьогодні виглядають так: нейромережі дають масштаб і гнучкість, символіка — правила й контроль, гібридні системи намагаються поєднати ці переваги, а емуляція мозку пропонує найглибший, але й найскладніший маршрут. Який із них спрацює — питання відкрите. Можливо, фінальна архітектура взагалі виявиться не “чистою школою”, а складною збіркою з кількох ідей одразу. І це, чесно кажучи, навіть найімовірніше.

Навіщо людям AGI і чому навколо нього стільки політики та страхів

Інтерес до AGI тримається не лише на фантазіях про “розумну машину”, а на дуже практичній надії: системи з ширшим інтелектуальним профілем можуть прискорювати науку, інженерію, аналіз даних, проєктування ліків, навчання і роботу з великими масивами знань. OECD прямо пов’язує розвиток ШІ з потенційною користю для наукового прогресу, продуктивності та суспільного добробуту, але водночас підкреслює, що користь не віддільна від довіри до таких систем. Тобто логіка проста: чим сильніший інструмент, тим вищі ставки.

Звідси й друга половина розмови — не про мрію, а про тертя з реальністю. Ризики AGI та ширше безпека ШІ починаються не з кіношних сценаріїв, а з уже знайомих проблем: помилкові висновки, шкідливі упередження, крихкість у новому контексті, небезпечне автономне виконання дій, витік або зловживання даними, а також кіберризики. NIST у своєму AI Risk Management Framework описує ризики для людей, організацій, суспільства й довкілля та наголошує, що надійний ШІ має бути не лише корисним, а й безпечним, стійким, підзвітним, прозорим, пояснюваним і справедливим. Іншими словами, модель, яка звучить переконливо, але поводиться непередбачувано, — це ще не “розумний помічник”, а потенційний головний біль.

Є й політичний вимір. Великі моделі стають базою для цілих екосистем продуктів, а це означає концентрацію інфраструктури, обчислювальних ресурсів, даних і впливу в небагатьох руках. Саме тому в офіційних документах дедалі частіше говорять не лише про інновації, а й про права людини, механізми нагляду, аудит ризиків і можливість обмежувати небезпечні застосування. Рада Європи у своїй рамковій конвенції про ШІ прямо ставить у центр людські права, демократію та верховенство права, а також вимагає оцінювати й пом’якшувати ризики протягом усього життєвого циклу системи. Тобто політика тут з’являється не “через паніку”, а тому, що щораз потужніший ШІ починає впливати не лише на ринок, а й на свободи, доступ до послуг, інформаційне середовище та безпеку.

Термін AI safety зазвичай означає не абстрактний страх перед машинами, а роботу над тим, щоб система діяла в межах заданої мети, не створювала неприйнятної шкоди і лишалася керованою під час реального використання. Близький термін alignment або узгодження — це спроба зробити так, щоб цілі, поведінка й обмеження моделі не роз’їжджалися з людськими намірами, правилами та суспільними цінностями. На практиці це не одна “велика чарівна кнопка”, а набір дисциплін: оцінювання, людський нагляд, тестування на зловживання, звітність про інциденти, кіберзахист, контроль даних і зрозумілі межі застосування. Саме на таких принципах стоять і рекомендації UNESCO щодо етики ШІ, і рамки на кшталт NIST AI RMF.

У праві й політиці 2026 року є ще один нюанс, який корисно знати. Регулятори часто сперечаються не про “AGI” як гучний футуристичний ярлик, а про general-purpose AI — моделі загального призначення, які можуть лягати в основу багатьох downstream-систем. Саме так побудовано AI Act ЄС: він окремо визначає general-purpose AI models, а для їхніх провайдерів вводить обов’язки щодо технічної документації, політики дотримання авторського права, публічного підсумку тренувального контенту, а для моделей із системним ризиком — ще й оцінювання та зниження ризиків, звітність про серйозні інциденти і належний рівень кіберзахисту. Правила для GPAI-моделей у ЄС почали застосовуватися з 2 серпня 2025 року, тоді як сам регламент загалом застосовуватиметься з 2 серпня 2026 року. Ось місток між мовою техно-дискусії й мовою закону: поки публіка сперечається про AGI, право вже регулює обов’язки тих, хто постачає моделі широкого призначення.

Тому ажіотаж навколо AGI має дві цілком земні причини. Оптимісти бачать інструмент, який може пришвидшити відкриття й зняти частину інтелектуальної рутини. Скептики бачать систему, яка при неправильному проєктуванні або занадто слабкому контролі масштабує не лише користь, а й помилки, нерівність і вразливості. І обидві сторони, якщо прибрати шум, говорять про одне й те саме: що сильнішим стає ШІ, то серйознішою стає розмова про відповідальність, регулювання ШІ та реальну, а не декоративну, безпеку.

Коли з’явиться AGI і чи можемо ми це «проспати»

Запитання коли буде AGI звучить просто, але впирається в не дуже зручну річ: у різних гравців різна фінішна стрічка. Наприклад, як ми вже казали раніше, OpenAI описує AGI як високоавтономні системи, що перевершують людей у більшості економічно цінної роботи, тоді як у рамці Google DeepMind AGI пропонують оцінювати не однією гучною фразою, а за поєднанням продуктивності, широти застосування та автономності. Через це одна й та сама система для когось може виглядати як “майже AGI”, а для когось — як дуже сильний, але ще не загальний інструмент.

Саме тому дата плаває. Якщо міряти AGI за економічною корисністю, прогноз буде один. Якщо за стійким узагальненням у широкому наборі нових задач — інший. Якщо додати вимогу до самостійного планування, довгих ланцюгів дій і надійності без постійної людської підстраховки, планка знову зсувається. Отже, питання не лише в швидкості прогресу, а й у тому, які критерії ми вважаємо достатніми для такого ярлика.

Звідси й друга плутанина: фраза AGI вже існує може з’являтися в медіа, корпоративних заявах або публічних дискусіях раніше, ніж виникне науковий консенсус. Гучне демо, сильний продукт чи навіть внутрішнє визначення компанії ще не дорівнюють незалежно підтвердженому статусу. Показово, що в історії OpenAI–Microsoft питання визнання AGI взагалі пов’язували з окремою процедурою перевірки, а не з автоматичним “усі й так побачать”. Це добре показує масштаб проблеми: якщо межа нечітка, то сам факт досягнення теж доведеться валідовувати, а не оголошувати в режимі пресрелізу.

Чи можемо ми це “проспати”? Швидше не як один драматичний момент, а як поступове зміщення межі. Люди можуть довго сперечатися, чи вже перед ними AGI, поки системи крок за кроком стають ширшими, автономнішими й надійнішими в нових середовищах. Тому наразі висновок такий: прогрес у напрямку загальніших систем справді видно, але AGI поки лишається радше ціллю, дослідницькою фішкою й предметом спору про прогноз, ніж стандартизованим діагнозом, щодо якого всі домовилися раз і назавжди.

Висновок

AGI, або загальний штучний інтелект, — це не просто “дуже сильна модель”, а система, від якої очікують трьох речей одночасно: універсальності в широкому колі задач, здатності узагальнювати й переносити знання в нові ситуації та достатньої автономності в діях і плануванні. Саме тому цей термін не варто плутати ні з чат-ботами, ні з генеративними моделями, ні з будь-яким вузьким ШІ, хай навіть дуже вражаючим. Сучасні системи явно рухаються в цей бік, але зазвичай ще не проходять строгі критерії, а сам термін лишається спірним, бо межа між “дуже широким інструментом” і справді загальним інтелектом досі не стандартизована.

FAQ (Поширені питання):

Сьогодні AGI найчастіше описують як дослідницьку ціль і клас майбутніх систем, а не як технологію, про яку можна впевнено сказати, що вона вже існує у завершеному й загальновизнаному вигляді.

ANI добре працює в конкретних задачах, а AGI має переносити навички між різними сферами, вчитися новому і не вимагати окремого “налаштування мозку” під кожен новий кейс.

Ні, не автоматично: великі мовні моделі можуть бути дуже широкими у діалозі, аналізі та генерації, але така універсальність ще не дорівнює загальному інтелекту з надійним узагальненням і автономністю.

У побутовій мові ці терміни часто змішують, але в академічних і філософських дискусіях strong AI інколи пов’язують ще й із питаннями свідомості та справжнього розуміння, яких термін AGI може прямо не вимагати.

Є багато тестів і бенчмарків, але загальна логіка така: дивляться не на один “супер іспит”, а на здатність узагальнювати, швидко набувати нових навичок, планувати дії та стабільно працювати в різних середовищах.

ARC-AGI — це сімейство бенчмарків, яке намагається вимірювати гнучкий інтелект через розв’язання нових задач із мінімумом прикладів, тому його часто згадують як спробу перевіряти не пам’ять, а здатність виводити правило.

Ні: частина дослідників вважає втіленість важливою для справжнього інтелекту, але інші допускають, що достатньо й софтверного агента, якщо він може діяти в цифрових середовищах на досить загальному рівні.

Ні, це різні речі: ASI — гіпотетичний етап, на якому система істотно перевершує людину майже в усіх когнітивних сферах, тоді як AGI зазвичай описують як рівень людської широти й гнучкості мислення.

Так, бо частина ризиків виникає ще до появи повноцінного AGI — коли системи стають потужнішими, автономнішими, масовішими і водночас залишаються помилковими, упередженими або погано контрольованими.

Тому що AGI — це не чітко стандартизований діагноз, а термін-ціль, і різні компанії, дослідники та медіа вкладають у нього різні критерії фінішу, змішуючи науку, бізнес і публічний ефект.